EU AI Act: Was deutsche Industrieunternehmen jetzt wissen müssen

Künstliche Intelligenz revolutioniert die Industrie. Doch mit dem EU AI Act steht nun erstmals ein umfassendes Regelwerk bereit, das den Einsatz von KI in Europa reguliert.

Die neue Ära der KI-Regulierung beginnt

Die Regulierung Künstlicher Intelligenz ist mit dem AI Act in der EU Realität geworden. Seit August 2024 ist die Verordnung in Kraft und bereits seit Februar 2025 gelten die ersten verbindlichen Bestimmungen. Für Unternehmen im Maschinenbau, der Produktion und anderen industriellen Bereichen bedeutet das: Die Zeit der unreglementierten KI-Nutzung ist vorbei. Hier erfahren Sie, wie Sie als Industrieunternehmen den neuen Compliance-Anforderungen gerecht werden können.

Was ist der EU AI Act und warum ist er relevant?

Der AI Act der EU ist weltweit das erste umfassende Gesetz zur Regulierung Künstlicher Intelligenz. Als EU-Verordnung gilt er direkt in allen Mitgliedsstaaten und betrifft jedes Unternehmen, das KI-Systeme entwickelt, vertreibt oder einsetzt. Besonders für die deutsche Industrie, die zunehmend auf datengetriebene Technologien setzt, bringt das neue Herausforderungen mit sich.

Die Relevanz für Industrieunternehmen ist beträchtlich: Laut einer DIHK-Digitalisierungsumfrage hatten im Jahr 2023 bereits 61 Prozent der deutschen Unternehmen KI im Einsatz oder planten deren Implementierung innerhalb der nächsten drei Jahre. Gleichzeitig drohen bei Verstößen gegen den EU AI Act laut Artikel 99 Abs. 3 Bußgelder von bis zu 35 Millionen Euro oder 7 Prozent des weltweiten Jahresumsatzes. Das macht es dringend erforderlich, die europäischen Regelungen zum Einsatz von KI zu kennen und einzuhalten.

Die wichtigsten Bestimmungen des EU AI Acts im Überblick

Der EU AI Act verfolgt einen risikobasierten Ansatz und unterscheidet zwischen vier Hauptkategorien von KI-Systemen. Je höher das Risiko, desto strenger die Anforderungen – von kompletten Verboten bis zu grundlegenden Transparenzpflichten.

So sieht die Vier-Säulen-Struktur der Regulierung aus:

- Verbotene KI-Systeme: Anwendungen mit inakzeptablem Risiko sind komplett untersagt

- Hochrisiko-KI-Systeme: strenge Anforderungen für kritische Anwendungen

- Begrenzte Risiko-Systeme: Transparenzpflichten für Chatbots und ähnliche Anwendungen

- Minimales Risiko: grundlegende Anforderungen für einfache KI-Tools

Laut AI Act verbotene KI-Praktiken (seit Februar 2025)

Einige Arten von KI-Systemen verbietet der AI Act komplett:

- Social-Scoring-Systeme zur Bewertung des sozialen Verhaltens

- biometrische Massenüberwachung im öffentlichen Raum (mit Ausnahmen für Strafverfolgung)

- Emotionserkennungssysteme am Arbeitsplatz und in Bildungseinrichtungen

- manipulative KI-Systeme, die menschliches Verhalten unbemerkt beeinflussen.

Hochrisiko-KI-Systeme: besonders relevant für die Industrie

Industrieunternehmen sind vor allem von den Regelungen für Hochrisiko-KI-Systeme betroffen. Diese umfassen:

- Kritische Infrastrukturen: Sicherheitssysteme in Verkehr, Energie- und Wasserversorgung

- Produktionssicherheit: KI-Systeme zur Überwachung und Steuerung industrieller Prozesse

- Personalmanagement: KI-gestützte Recruiting-, Bewertungs- und Überwachungssysteme

- Qualitätskontrolle: Automatisierte Prüf- und Inspektionssysteme

Der EU AI Act definiert in Anhang III acht Hauptanwendungsbereiche für Hochrisiko-KI-Systeme. Industrieunternehmen sollten verstehen, welche spezifischen Anwendungen in ihrem Bereich unter diese Kategorien fallen:

- Biometrische Systeme und Identifikation: biometrische Fernidentifikationssysteme (mit Ausnahme der biometrischen Verifikation), biometrische Kategorisierungssysteme, die auf sensible oder geschützte Attribute schließen, Systeme zur Erkennung von Emotionen

- Kritische Infrastrukturen: Sicherheitskomponenten bei der Verwaltung und dem Betrieb kritischer digitaler Infrastrukturen, im Straßenverkehr und bei der Versorgung mit Wasser, Gas, Wärme und Strom

- Bildung und Berufsbildung: intelligente Systeme zur Bestimmung des Zugangs, der Zulassung oder Zuweisung zu Bildungseinrichtungen, Bewertung von Lernergebnissen, Überwachung von Schülerverhalten bei Prüfungen

- Beschäftigung und Personalmanagement: KI-Systeme für Einstellung, Beförderung und Vertragsbeendigung, Aufgabenzuweisung basierend auf Persönlichkeitsmerkmalen sowie Leistungsüberwachung und -bewertung

Allzweck-KI-Modelle (GPAI)

Für große KI-Modelle mit allgemeinem Verwendungszweck gelten seit August 2025 spezielle Regeln. Betreibende von Modellen ab 10²⁵ FLOPS müssen systemische Risikobewertungen durchführen, umfassende Dokumentationspflichten erfüllen und schwerwiegende Vorfälle melden.

Was sind FLOPS?

FLOPS steht für „Floating Point Operations Per Second“ und ist eine Maßeinheit für die Rechenleistung von Computersystemen. Sie gibt an, wie viele Gleitkomma-Operationen (mathematische Berechnungen mit Dezimalzahlen) ein System pro Sekunde durchführen kann.

10²⁵ FLOPS entsprechen 10 Quintilliarden Rechenoperationen pro Sekunde – eine astronomische Zahl, die nur die größten und leistungsfähigsten KI-Modelle wie GPT-4 oder vergleichbare Systeme erreichen. Zum Vergleich: Ein durchschnittlicher Desktop-Computer schafft etwa 10⁹ bis 10¹² FLOPS. Diese Schwelle stellt sicher, dass nur die mächtigsten KI-Systeme mit potenziell systemischen Risiken den strengsten Regulierungen unterliegen.

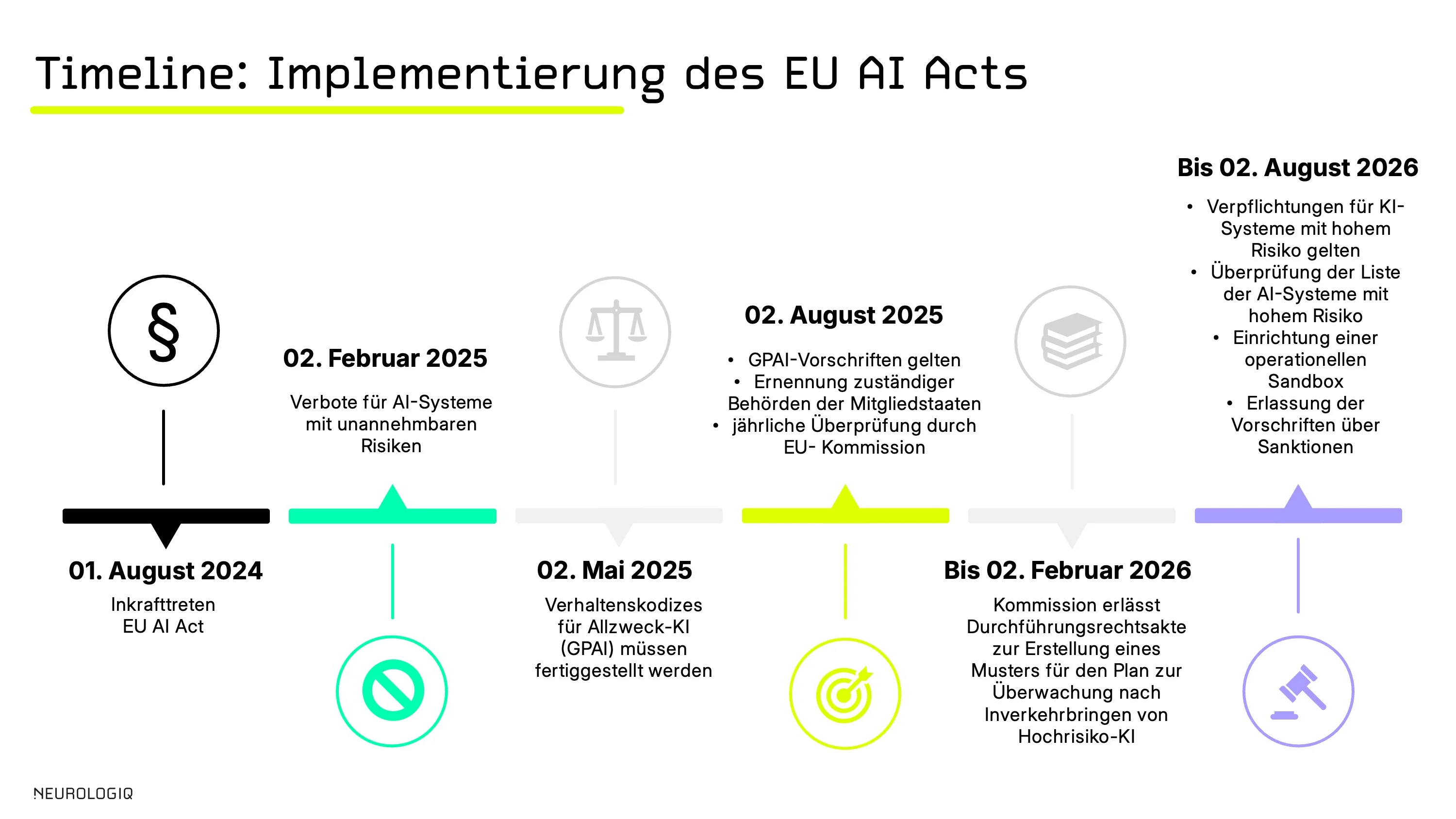

Der Zeitplan für den EU AI Act: Wann welche Regelungen greifen

Die Umsetzung des EU AI Acts erfolgt schrittweise. Bereits seit Februar 2025 sind verbotene KI-Praktiken untersagt und die KI-Kompetenzpflicht gilt für alle Unternehmen. Ab August 2025 greifen die Vorschriften für Allzweck-KI-Modelle, während die vollständige Anwendung des Gesetzes für August 2026 vorgesehen ist.

Die gestaffelte Einführung ermöglicht es Unternehmen, sich schrittweise auf die neuen Anforderungen vorzubereiten. Hier sind die wichtigsten Meilensteine im Detail:

Phase 1: Februar 2025 – erste Verbote und Grundlagen

Das Verbot von KI-Systemen mit inakzeptablem Risiko trat im Februar 2025 in Kraft, einschließlich Social Scoring und manipulativer Systeme. Parallel dazu wurden KI-Kompetenzpflichten für alle Unternehmen verbindlich – das bedeutet konkret: Mitarbeitende müssen so geschult werden, dass sie intelligente Systeme verstehen, deren Risiken erkennen und angemessen damit umgehen können. Erste Sanktionsmöglichkeiten wurden aktiviert, seitdem drohen Bußgelder bis zu 35 Millionen Euro oder 7 Prozent des Jahresumsatzes. Zudem mussten Unternehmen, die Hochrisiko-Systeme betreiben, KI-Inventare erstellen und Schulungsprogramme starten.

Phase 2: Mai 2025 – Governance und Verhaltenskodizes

Ab Mai 2025 mussten Anbieter von Allzweck-KI-Modellen detaillierte Verhaltenskodizes fertigstellen und implementieren. Diese umfassen Richtlinien für Datennutzung, Modelltraining und Risikomanagement. Governance-Strukturen wurden in Unternehmen etabliert. Unternehmen mussten ihre internen Prozesse anpassen und es wurde empfohlen, Compliance-Teams aufbauen.

Phase 3: August 2025 – GPAI-Regulierung wurde scharfgestellt

Ab August 2025 traten die vollständigen Vorschriften für General Purpose AI (GPAI) in Kraft. Modelle mit hohen Wirkungskapazitäten (ab 10²⁵ FLOPS) oder vergleichbaren Fähigkeiten und Auswirkungen müssen seitdem systemische Risikobewertungen durchführen und regelmäßige Sicherheitstests absolvieren. Zuständige nationale Behörden für die Überwachung von KI-Systemen sollten offiziell benannt werden. Periodische Überwachungsmaßnahmen begannen, bei denen Unternehmen bei Bedarf ihre Compliance nachweisen müssen. Zudem starteten Marktüberwachungsmaßnahmen und Unternehmen müssen nun Meldepflichten bei schwerwiegenden Vorfällen umsetzen.

Phase 4: Februar 2026 – Detailregulierung für Hochrisiko-KI

Ab Februar 2026 erlässt die EU-Kommission detaillierte Durchführungsrechtsakte, die präzise definieren, wie Compliance-Anforderungen umgesetzt werden müssen. Muster für Überwachungspläne von Hochrisiko-KI werden veröffentlicht, die als Vorlage für Unternehmen dienen. Diese Phase bringt Klarheit für bisher unklare Grenzfälle und definiert einheitliche Standards für Risikomanagementsysteme, technische Dokumentation und Post-Market-Monitoring. Unternehmen erhalten konkrete Leitfäden für die praktische Umsetzung.

Phase 5: August 2026 – vollständige Anwendung

Der EU AI Act greift mit allen Bestimmungen ab August 2026 vollständig. Hochrisiko-KI-Systeme müssen CE-gekennzeichnet sein, umfassende Dokumentationen vorliegen und kontinuierliche Überwachung gewährleistet sein. Alle Compliance-Anforderungen sind verbindlich, einschließlich Konformitätsbewertungen, Risikomanagementsystemen und menschlicher Aufsicht. Nur wenige spezifische Ausnahmen gelten noch – etwa für bestimmte Forschungsanwendungen oder Systeme in der Entwicklungsphase. Ab diesem Zeitpunkt sind alle Marktakteure vollständig reguliert.

Sind Sie bereit für den EU AI Act?

Als Experte für Industrial AI unterstützen wir Sie dabei, KI-Lösungen zu entwickeln, die zu Ihrem Unternehmen passen und mit dem AI Act der EU im Einklang stehen. NEUROLOGIQ steht Ihnen auf dem gesamten Weg von der Potenzialanalyse bis zur erfolgreichen Umsetzung intelligenter Systeme zur Seite.

Unverbindliche Beratung starten

Risikoklassifizierung: Welche KI-Systeme sind betroffen?

Der EU AI Act kategorisiert intelligente Systeme systematisch nach ihrem Risikopotenzial. Während KI-Systeme mit inakzeptablem Risiko bereits seit Februar 2025 verboten sind, stehen Hochrisiko-KI-Systeme im Fokus der industriellen Anwendungen. Besonders relevant für die Industrie sind Systeme in kritischen Infrastrukturen, zur Personalverwaltung, in der Produktionssicherheit und bei Qualitätskontrollsystemen.

Für Hochrisikosysteme gelten ab August 2026 strenge Anforderungen wie Risikomanagementsysteme, technische Dokumentation und menschliche Aufsicht. KI-Systeme mit begrenztem Risiko wie Chatbots und Empfehlungssysteme müssen Transparenzpflichten erfüllen, während einfache Automatisierungstools lediglich grundlegenden Anforderungen zu entsprechen haben.

Compliance-Anforderungen durch den EU AI Act für Industrieunternehmen

Für Unternehmen ergeben sich verschiedene Pflichten, abhängig von ihrer Rolle in der KI-Wertschöpfungskette. Der AI Act definiert klare Verantwortlichkeiten für alle Akteure in der EU: Anbietende und Entwickelnde tragen die Hauptlast der Compliance-Anforderungen und müssen bei Hochrisikosystemen eine CE-Kennzeichnung anbringen. Betreibende sind für menschliche Aufsicht, Datenqualität und kontinuierliches Monitoring verantwortlich.

Wer KI-Systeme anbietet, muss:

- Risikomanagementsysteme etablieren

- technische Dokumentationen bereitstellen

- Konformitätsbewertungen durchführen

- CE-Kennzeichnungen anbringen

- Post-Market-Monitoring betreiben

Betreibende von KI-Systemen müssen:

- menschliche Aufsicht sicherstellen

- Eingabedaten überwachen

- Logs und Aufzeichnungen führen

- Fundamental Rights Impact Assessments (FRIA) für bestimmte Hochrisikosysteme durchführen (zusätzlich können Datenschutzfolgenabschätzungen nach DSGVO erforderlich sein, wenn personenbezogene Daten verarbeitet werden) Neben diesen grundlegenden rollenspezifischen Anforderungen gibt es weitere wichtige Compliance-Aspekte, die alle Unternehmen betreffen. Diese sind oft komplex und erfordern eine detaillierte Betrachtung:

KI-Kompetenzpflicht für alle Unternehmen

Seit Februar 2025 müssen alle Unternehmen sicherstellen, dass ihre Mitarbeitenden über ausreichende KI-Kompetenzen verfügen. Das umfasst Schulungen zu KI-Grundlagen, Verständnis für Risiken und Grenzen sowie Kenntnisse über rechtliche Anforderungen. Diese Pflicht gilt unabhängig von der Unternehmensgröße oder dem Einsatzbereich intelligenter Systeme.

Dokumentationspflichten für Hochrisikosysteme

Anbietende müssen umfassende technische Dokumentationen erstellen, die Systemarchitektur, Trainingsverfahren, Datenquellen und Risikobewertungen enthalten. Diese Unterlagen müssen während der gesamten Lebensdauer des Systems aktuell gehalten werden.

Menschliche Aufsicht und Kontrolle

Hochrisiko-KI-Systeme müssen so konzipiert werden, dass sie effektiv von natürlichen Personen überwacht werden können. Betreibende müssen qualifizierte Personen benennen, die das System verstehen und bei Bedarf eingreifen können.[A11]

Herausforderungen und Kosten der Umsetzung des EU AI Acts

Die Implementierung des EU AI Act bringt einige Herausforderungen mit sich. Besonders für mittelständische Industrieunternehmen stellt die Komplexität der Verordnung eine Hürde dar. Viele Unternehmen sind unsicher, welche ihrer KI-Anwendungen unter welche Kategorie fallen, und müssen neue Governance-Strukturen aufbauen.

Die Umsetzung der Regularien und Schulung der Mitarbeitenden gehen mit zusätzlichem Aufwand und Kosten einher. Wie viel Unternehmen investieren müssen, hängt von verschiedenen Faktoren ab, wie:

- Anzahl der eingesetzten KI-Systeme

- Komplexität der Hochrisikoanwendungen

- bestehende Compliance-Strukturen

- Unternehmensgröße und -ressourcen

Doch der EU AI Act birgt nicht nur Herausforderungen, sondern auch Chancen.

Chancen und Potenziale des AI Acts für die deutsche Industrie

Unternehmen, die frühzeitig auf Compliance mit dem EU AI Act setzen, kann dies als Differenzierungsmerkmal dienen und Vertrauen bei Kundschaft und Partnern aufbauen. Klare Regeln schaffen Planungssicherheit und fördern die Entwicklung vertrauenswürdiger, ethischer KI-Systeme.

Die systematische Risikobewertung verbessert die Qualität intelligenter Systeme, während Dokumentationspflichten Best Practices fördern. Menschliche Aufsicht reduziert Fehlerrisiken und stärkt das Vertrauen in automatisierte Systeme. Langfristig lohnt sich also die Investition in entsprechende Compliance-Maßnahmen. So stärkt der EU AI Act die europäische KI-Souveränität und schafft einen fairen Wettbewerb.

Praktische Handlungsempfehlungen zur Einhaltung des EU AI Acts

Da wichtige Bestimmungen des AI Acts in der EU bereits in Kraft sind, sollten Sie zunächst prüfen, ob Sie Hochrisiko-KI-Systeme einsetzen, und systematisch vorgehen. Als erste Maßnahme empfiehlt sich die Identifikation und Dokumentation aller eingesetzten KI-Systeme mit Fokus auf Hochrisiko-Anwendungen (gesetzlich verpflichtend ist ein KI-Verzeichnis nur für Anbieter und Betreiber von Hochrisiko-KI-Systemen). Der Aufbau eines Compliance-Teams mit klaren Verantwortlichkeiten und die Sicherstellung der seit Februar vorgeschriebenen KI-Kompetenz bei Mitarbeitenden sind essenziell.

Mittelfristige Maßnahmen (bis August 2026):

- Etablierung von Governance-Strukturen für KI-Management

- Aufbau von Dokumentationssystemen für technische Unterlagen

- Bewertung von Lieferanten auf AI-Act-Compliance

- Implementierung von Monitoring-Systemen für kontinuierliche Überwachung

Mit strategischer Vorbereitung in eine AI-Act-konforme KI-Zukunft starten

Der EU AI Act ist mehr als nur ein Regelwerk – er definiert die Zukunft Künstlicher Intelligenz in Europa. Unternehmen, die jetzt proaktiv handeln, sichern sich nicht nur rechtliche Compliance, sondern auch Wettbewerbsvorteile in einem zunehmend regulierten Markt.

Die Zeit für Vorbereitung wird knapper: Mit den Fristen bis August 2026 müssen Unternehmen bereits heute die Weichen stellen. Dabei geht es nicht nur um die Vermeidung von Bußgeldern, sondern um den Aufbau vertrauenswürdiger, nachhaltiger KI-Systeme, die den Erfolg in der digitalen Zukunft sichern.

Wer den Weg zur AI-Act-Compliance strategisch angeht, kann aus der regulatorischen Herausforderung einen echten Innovationstreiber machen. NEUROLOGIQ steht Ihnen dabei als erfahrener Partner zur Seite – mit maßgeschneiderten Automatisierungslösungen, strategischer Beratung und KI-Workshops, die Ihre Mitarbeitenden zum sicheren Umgang mit intelligenten Systemen befähigen.

Veröffentlicht am

Zuletzt aktualisiert am